Einführung in Wan 2.1 und wie man mit WanVideo magische Videos erstellt

Inhaltsverzeichnis

- Was ist Wan 2.1?

- Hauptmerkmale von Wan 2.1

- Wie WanVideo funktioniert

- Erste Schritte mit WanVideo

- Leitfaden zur Text-zu-Video-Erstellung

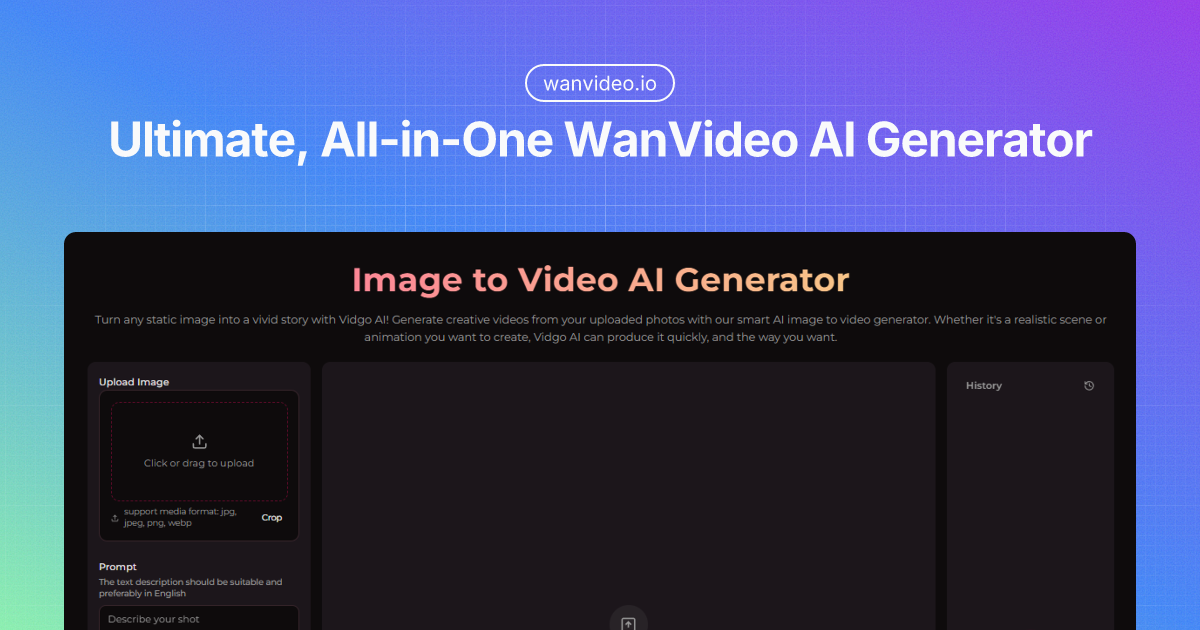

- Bild-zu-Video-Transformation

- Fortgeschrittene Tipps für bessere Ergebnisse

- Technische Spezifikationen

- Vergleich Wan 2.1 mit anderen Video-KI-Modellen

- Zukunft der KI-Videogenerierung

- Fazit

Was ist Wan 2.1?

Wan 2.1 ist ein bahnbrechendes KI-Videogenerierungsmodell, das von Alibabas Tongyi Lab entwickelt wurde. Veröffentlicht als Open-Source-Suite von Video-Basismodellen, stellt Wan 2.1 einen bedeutenden Fortschritt dar, um hochwertige Videoerstellung für jeden zugänglich zu machen. Dieses leistungsstarke KI-System kann einfache Texteingaben oder statische Bilder in dynamische, flüssige Videos mit bemerkenswerter Qualität und Realismus verwandeln.

Als eines der fortschrittlichsten Open-Source-Videogenerierungsmodelle, die derzeit verfügbar sind, hat Wan 2.1 schnell an Popularität bei Kreativen, Entwicklern und KI-Enthusiasten gewonnen. Besonders hervorzuheben ist die Fähigkeit, auf handelsüblicher Hardware zu laufen und dennoch professionelle Ergebnisse zu liefern.

Die offizielle WanVideo-Website dient als Hauptplattform für den Zugriff auf diese leistungsstarken Tools und bietet sowohl kostenlose als auch Premium-Optionen für verschiedene Nutzergruppen. Egal, ob Sie als Content-Creator Ihre Videos verbessern, als Entwickler die Videogenerierung in Anwendungen integrieren oder einfach als Enthusiast die Möglichkeiten der KI erforschen möchten – Wan 2.1 bietet einen zugänglichen Einstieg in die Welt der KI-Videoerstellung.

Hauptmerkmale von Wan 2.1

Wan 2.1 hebt sich im überfüllten Feld der KI-Videogeneratoren durch mehrere beeindruckende Fähigkeiten hervor:

Mehrere Generierungsmethoden

- Text-zu-Video (T2V): Verwandeln Sie schriftliche Beschreibungen in vollständig animierte Videos

- Bild-zu-Video (I2V): Erwecken Sie statische Bilder mit natürlicher Bewegung zum Leben

- Video-Editierung: Verbessern oder bearbeiten Sie bestehende Videoinhalte

- Text-zu-Bild: Erzeugen Sie Standbilder aus Textbeschreibungen

- Video-zu-Audio: Ergänzen Sie Videoinhalte um passende Audiospuren

Technische Vorteile

- Hochwertige Ausgabe: Erstellt Videos mit flüssigen Bewegungen und realistischen Physik-Effekten

- Effizienz: Das 1,3B-Parameter-Modell benötigt nur 8,19GB VRAM und ist somit auf handelsüblichen GPUs einsetzbar

- Mehrsprachige Unterstützung: Funktioniert mit englischen und chinesischen Eingaben

- Open-Source-Architektur: Für akademische, Forschungs- und kommerzielle Nutzung verfügbar

Leistungsbenchmarks

Wan 2.1 belegt den ersten Platz auf der VBench-Bestenliste, einem umfassenden Benchmark für Videogenerierungsmodelle, mit besonders hohen Bewertungen in den Bereichen Bewegungsqualität, räumliche Relationen und Multiobjektinteraktionen. Damit zählt es zu den leistungsfähigsten aktuellen Videogenerationssystemen und steht in Konkurrenz mit proprietären Modellen wie OpenAIs Sora.

Wie WanVideo funktioniert

Die Magie hinter WanVideo liegt in seiner ausgefeilten KI-Architektur. Kernbestandteile von Wan 2.1 sind:

- 3D Variational Autoencoder (Wan-VAE): Effiziente Kompression und Dekompression von Videodaten

- Video Diffusion DiT: Generiert hochwertige Videoframes

- Flow Matching Framework: Sorgt für reibungslose Übergänge zwischen den Frames

- T5 Encoder: Verarbeitet Texteingaben für eine präzise Darstellung

- Transformer-Blöcke mit Cross-Attention: Verknüpft textliche Konzepte mit visuellen Elementen

Dieses komplexe System arbeitet nahtlos zusammen, um Ihre Eingaben (egal ob Text oder Bild) zu interpretieren und ein stimmiges Video zu generieren, das den gewünschten Inhalt exakt repräsentiert. Der Prozess gliedert sich in mehrere Stufen:

- Eingabeverarbeitung (Textkodierung oder Bildanalyse)

- Inhaltsplanung und Szenenkomposition

- Frame-für-Frame-Generierung mit zeitlicher Kohärenz

- Nachbearbeitung zur Qualitäts- und Kohärenzsteigerung

Das Ergebnis ist ein Video, das nicht nur als Einzelbild überzeugt, sondern auch kontinuierliche, logische Bewegungsabläufe während der gesamten Abspielzeit bietet.

Erste Schritte mit WanVideo

Der Einstieg in WanVideo ist auch für Anfänger unkompliziert. So starten Sie Ihre KI-Videoerstellung:

Schritt 1: Wählen Sie Ihre Erstellungs-Methode

WanVideo bietet zwei Hauptmethoden an:

- Text-zu-Video (T2V): Verwandeln Sie schriftliche Beschreibungen in animierte Videos

- Bild-zu-Video (I2V): Erwecken Sie Bilder mit flüssigen Bewegungen zum Leben

Jede Methode hat eigene Vorteile: Text-zu-Video bietet maximale kreative Freiheit, während Bild-zu-Video mehr Kontrolle über den visuellen Stil und Inhalt gibt.

Schritt 2: Konto anlegen

Obwohl WanVideo einige kostenlose Generierungsfunktionen bietet, profitieren Sie mit einem Konto von:

- Höherer Auflösung

- Längeren Videodauern

- Erweiterte Bearbeitungsfunktionen

- Gespeicherte Projekte und Historie

- Download der Videos ohne Wasserzeichen

Die Registrierung ist einfach und erfordert lediglich eine E-Mail-Adresse.

Schritt 3: Vorlage auswählen

WanVideo stellt verschiedene Vorlagen zur Verfügung:

- Durchsuchen Sie die verfügbaren Templates

- Wählen Sie eine Vorlage, die Ihrer kreativen Vision entspricht

- Manche Vorlagen sind effektbasiert und enthalten bereits Prompts

- Andere ermöglichen die freie Anpassung eigener Prompts

Schritt 4: Inhalte vorbereiten

Für Bild-zu-Video:

- Laden Sie ein oder zwei Bilder hoch

- Einzelbild: Ein Bild für die direkte Umwandlung

- Zwei Bilder: Zwei Bilder für einen Vergleich nebeneinander

- Nutzen Sie das integrierte Zuschneidewerkzeug

- Zoomstufe anpassen

- Seitenverhältnis ändern

- Endergebnis im Voraus betrachten

- Warten Sie, bis der Upload abgeschlossen ist

Für Text-zu-Video:

- Prompt in das Texteingabefeld eingeben

- Seien Sie präzise bezüglich Szene, Bewegung und Stil

- Nutzen Sie die Kopieren- und Löschen-Buttons zur Verwaltung Ihres Prompts

Schritt 5: Video generieren

- Auf „Video generieren“ klicken

- Verifizierungsprozess abschließen

- Warten Sie die Generierung ab (in der Regel einige Minuten)

- Das Video erscheint im Ergebnisbereich

Schritt 6: Download und Teilen

Nach der Generierung:

- Vorschau des Videos direkt im Browser

- Download mit Wasserzeichen (kostenlos)

- Download ohne Wasserzeichen (Premium-Funktion)

- Weitere Generierungsinformationen einsehen

- Zugriff auf Ihre Generierungshistorie

Schritt 7: Verlauf verwalten

WanVideo speichert all Ihre Erstellungsvorgänge:

- Zugriff auf den Verlauf am rechten Rand (Desktop) bzw. im unteren Bereich (Mobil)

- Vorherige Generierungen ansehen

- Videos erneut herunterladen

- Details zur Generierung überprüfen

- Ihren Kreditverbrauch überwachen

Tipps für beste Ergebnisse

- Verwenden Sie hochwertige Bilder

- Seien Sie präzise in Ihren Textprompts

- Probieren Sie verschiedene Templates aus

- Kreditguthaben vor der Generierung prüfen

- Zuschneidewerkzeug für das richtige Seitenverhältnis nutzen

- Zwei Bilder für Vergleichsvideos verwenden

Leitfaden zur Text-zu-Video-Erstellung

Die Funktion Text zu Video ist vielleicht der magischste Aspekt von WanVideo und ermöglicht es, Ihre Vorstellungskraft mit nur wenigen Worten Wirklichkeit werden zu lassen. So erzielen Sie beste Ergebnisse:

Effektive Prompts erstellen

Die Qualität Ihres Prompts hat direkten Einfluss auf Ihr Video. Beachten Sie folgende Hinweise:

-

Seien Sie genau: „Ein roter Sportwagen, der bei Sonnenuntergang schnell entlang einer Küstenstraße fährt“ funktioniert besser als „ein Auto fährt“

-

Visuelle Details einbauen: Erwähnen Sie Farben, Lichtverhältnisse, Wetter, Atmosphäre

-

Bewegung beschreiben: Definieren Sie, wie sich Objekte bewegen („schwingt sanft“, „rast schnell“)

-

Szene festlegen: Hintergrund und Umgebung beschreiben

-

Stil angeben: Künstlerrichtung ergänzen wie „fotorealistisch“, „Anime-Stil“ oder „cinematisch“

Muster-Prompt-Vorlage

[Subjekt] [Aktion] in/auf [Ort] mit [Details] während [Tageszeit], [Stilreferenz]

Beispiel: „Ein majestätischer Adler gleitet über schneebedeckte Berge, Sonnenlicht funkelt auf seinen Flügeln während der Goldenen Stunde, filmische Qualität“

Parameter einstellen

Mit WanVideo können Sie diverse Generierungsparameter anpassen:

- Videolänge: Typischerweise 5-10 Sekunden (längere Videos können Kohärenz verlieren)

- Auflösung: Standard ist 480p, 720p für Premium-Nutzer

- Guidance Scale: Bestimmt, wie genau die KI dem Prompt folgt (höher = wörtlicher)

- Seed: Notieren Sie sich die Zahl, um ähnliche Videos erneut zu erzeugen

Iterative Verbesserung

Erwarten Sie beim ersten Versuch kein perfektes Ergebnis. Besser ist ein iterativer Ansatz:

- Mit einfachem Prompt starten

- Generiertes Video ansehen

- Prompt anhand von Stärken/Schwächen anpassen

- Neue Generierung durchführen

- So oft wiederholen, bis Sie zufrieden sind

Bild-zu-Video-Transformation

Mit der Funktion Bild zu Video können Sie statische Bilder animieren und so Fotos, Illustrationen oder KI-generierte Bilder zum Leben erwecken. Tipps zur effektiven Nutzung:

Das richtige Ausgangsbild wählen

Nicht jedes Bild eignet sich gleichermaßen. Ideal sind:

- Klare Motive mit deutlichen Konturen

- Potenzielles Bewegungsmoment

- Gute Komposition (Vorder- und Hintergrund)

- Hohe Auflösung/Qualität

Ungeeignet sind: Verwaschene Bilder, zu viele überlappende Motive oder extrem komplexe Szenen.

Bewegungsparameter einstellen

WanVideo erlaubt es, die Animation zu steuern:

- Bewegungsstärke: Wie stark/auffällig soll die Bewegung sein?

- Bewegungsrichtung: Wohin bewegt sich das Bildhauptmotiv?

- Fokuspunkt: Welcher Bildteil steht im Zentrum der Animation?

- Dauer: Wie lange soll das Video laufen?

Ergänzenden Text hinzufügen

Erhöhen Sie die Ergebnisse mit einer textuellen Anweisung:

- Bild hochladen

- Kurze Beschreibung der gewünschten Bewegung/Effekte eingeben

- Parameter nach Bedarf anpassen

- Video erzeugen

Die Kombination aus Bild- und Texteingabe führt oft zu den besten Resultaten.

Nachbearbeitungsmöglichkeiten

Nach der Generierung bietet WanVideo:

- Wiedergabegeschwindigkeit verändern

- Übergänge hinzufügen

- Filter anwenden

- Text-Overlays einfügen

- Hintergrundmusik oder Soundeffekte ergänzen

Durch solche Feinschliffe wirkt Ihr Video besonders professionell.

Fortgeschrittene Tipps für bessere Ergebnisse

Über die Grundlagen hinaus können Sie mit diesen Methoden Ihre WanVideo-Kreationen weiter verbessern:

Prompt Engineering

- Verwenden Sie Negative Prompts (was soll NICHT erscheinen)

- Setzen Sie Gewichtungen für zentrale Elemente (beautiful::0.8, detailed::1.2)

- Kombinieren Sie mehrere Prompts mit Übergängen für komplexe Erzählungen

Technische Optimierung

- Für lokale Installationen: Verwenden Sie Half-Precision (fp16) zur Reduktion des VRAM-Verbrauchs

- Ähnliche Videos in Batches verarbeiten für bessere Effizienz

- Nutzen Sie „ancestral sampling“ für kreativere, aber weniger exakte Resultate

Kreative Workflows

- Storyboard-Abfolge aus mehreren kurzen Clips zusammenbauen

- Für Eröffnungsszenen Bild-zu-Video nutzen, dann Text-zu-Video für Aktion

- Kombinieren Sie WanVideo mit anderen KI-Tools für ganze Produktionspipelines

Häufige Probleme und Lösungen

| Problem | Lösung |

|---|---|

| Video ohne zusammenhängende Bewegung | Bewegungsrichtung im Prompt präziser angeben |

| Schwache Objekterkennung | Klarere Beschreibung der Schlüsselelemente |

| Zeitliche Inkonsistenz | Videolänge reduzieren oder Szene vereinfachen |

| Artefakte/Fehler | Anderen Seed wählen oder Komplexität verringern |

| Geringe Auflösung | Premium-Upgrade oder Upscaling-Tools nutzen |

Technische Spezifikationen

Wer sich für Technik interessiert, hier die Details zu Wan 2.1:

Modellarchitektur

Wan 2.1 gibt es in zwei Hauptvarianten:

- 1,3B-Parameter-Modell: Kompakteste Version, läuft auf Consumer-Hardware

- 14B-Parameter-Modell: Vollausbau für professionelle Anwendungen

Architektur umfasst:

- Dimension: 1536

- Eingabedimension: 16

- Ausgabedimension: 16

- Feedforward-Dimension: 8960

- Frequenzdimension: 256

- Anzahl der Köpfe: 12

- Anzahl der Layer: 30

Weitere technische Details finden Sie in der offiziellen Model Card auf Hugging Face und in der Replicate Dokumentation.

Hardware-Anforderungen

Für das 1,3B-Modell:

- Mindestens 8,19GB VRAM

- Kompatibel mit RTX 3090/4090 GPUs

- Generierungszeit: ca. 4 Minuten für ein 5-Sekunden-Video (ohne Optimierung)

Für das 14B-Modell:

- Empfohlen: 24GB+ VRAM

- Profi-GPUs empfohlen

- Generierungszeit: variabel je nach Hardware

Details zur Kompatibilität und Optimierung finden Sie im ComfyUI Wiki und in Reddit-Community-Threads.

Software-Abhängigkeiten

Für lokale Installation:

- Python 3.8+

- PyTorch 2.0+

- CUDA 11.7+ (für GPU-Beschleunigung)

- FFmpeg (für Videobearbeitung)

Installationsanleitungen und Hilfen finden Sie im GitHub-Repository und in der offiziellen Alibaba Cloud-Dokumentation.

Vergleich Wan 2.1 mit anderen Video-KI-Modellen

Wie schlägt sich Wan 2.1 gegen andere bekannte Videomodelle?

Wan 2.1 vs. proprietäre Modelle

| Merkmal | Wan 2.1 | OpenAIs Sora | Runway Gen-2 |

|---|---|---|---|

| Verfügbarkeit | Open Source | Limited Access | Abo-Modell |

| Preis | Kostenlos/günstig | Nicht öffentlich | $15-$95/Monat |

| Videolänge | 5-10 Sekunden | Bis zu 60 Sek. | Bis zu 16 Sek. |

| Auflösung | Bis 720p | Bis 1080p | Bis 1080p |

| Hardware | Consumer-GPUs | Nur Cloud | Nur Cloud |

| Anpassbarkeit | Hoch | Begrenzte | Mittel |

Leistungsvergleich

Wan 2.1 überzeugt bei:

- Bewegungsqualität und Physik

- Lokaler Ausführung auf Consumer-Hardware

- Open-Source-Flexibilität

Vorteile anderer Modelle:

- Längere Videos (Sora)

- Höhere Auflösung (kommerzielle Modelle)

- Besser bei Gesichtern/komplexen Szenen (spezialisierte Modelle)

Die Open-Source-Natur von Wan 2.1 sorgt für stetige Verbesserung durch Community-Beiträge.

Zukunft der KI-Videogenerierung

Die Veröffentlichung von Wan 2.1 ist ein Meilenstein für die Demokratisierung der KI-Videoerstellung – und erst der Anfang.

Kommende Entwicklungen

- Längere Videos: Künftige Versionen erlauben mehr als 5-10 Sekunden

- Höhere Auflösungen: 1080p und 4K kommen mit effizienteren Modellen

- Verbesserte Zeitkonsistenz: Bessere Bewegungs- und Szenenverläufe

- Multimodale Integration: Nahtlose Verbindung von Video, Audio und interaktiven Elementen

- Spezialisierte Modelle: Variationen für spezielle Einsatzzwecke, z.B. Produkte, Natur

Potenzielle Anwendungsgebiete

KI-Videoerzeugung wird viele Branchen wandeln:

- Content Creation: Kleine Creators stellen Profi-Videos her

- E-Commerce: Dynamische Produktvideos aus Katalogbildern

- Bildung: Komplexe Sachverhalte animiert erklären

- Gaming: Generierung von Spielassets/Cinematics

- Virtual Reality: Spontane, immersive Umgebungen erschaffen

Fazit

Wan 2.1 und die WanVideo-Plattform stehen für eine echte Demokratisierung der Videogenerierung. Durch die Zugänglichkeit leistungsstarker KI-Videotools für alle – vom Hobbyisten bis zum Profi – eröffnet das Tongyi Lab von Alibaba neue kreative Möglichkeiten, die früher nur großen Studios vorbehalten waren.

Ob Sie nun atemberaubende Text-zu-Video-Inhalte erstellen, Bilder mit Bild-zu-Video-Transformation zum Leben erwecken oder die KI-Kreativität neu entdecken möchten, Wan 2.1 bietet Ihnen alles für den Einstieg.

Wie bei jeder neuen Technologie sind die spannendsten Anwendungen vermutlich die, an die wir jetzt noch gar nicht denken. Die Open-Source-Basis von Wan 2.1 sorgt dafür, dass Innovation rasant weitergeht – mit Beiträgen von Entwicklern und Kreativen weltweit.

Die Zukunft der Videoproduktion ist da – und sie ist so zugänglich wie nie. Besuchen Sie doch gleich die offizielle WanVideo-Website und starten Sie mit Ihren eigenen KI-Videos. Ihre Vorstellungskraft ist die einzige Grenze.