แนะนำ Wan 2.1 และวิธีใช้ WanVideo สร้างวิดีโอเวทมนตร์

สารบัญ

- Wan 2.1 คืออะไร?

- ฟีเจอร์เด่นของ Wan 2.1

- WanVideo ทำงานอย่างไร

- เริ่มต้นใช้งาน WanVideo

- คู่มือสร้างวิดีโอจากข้อความ

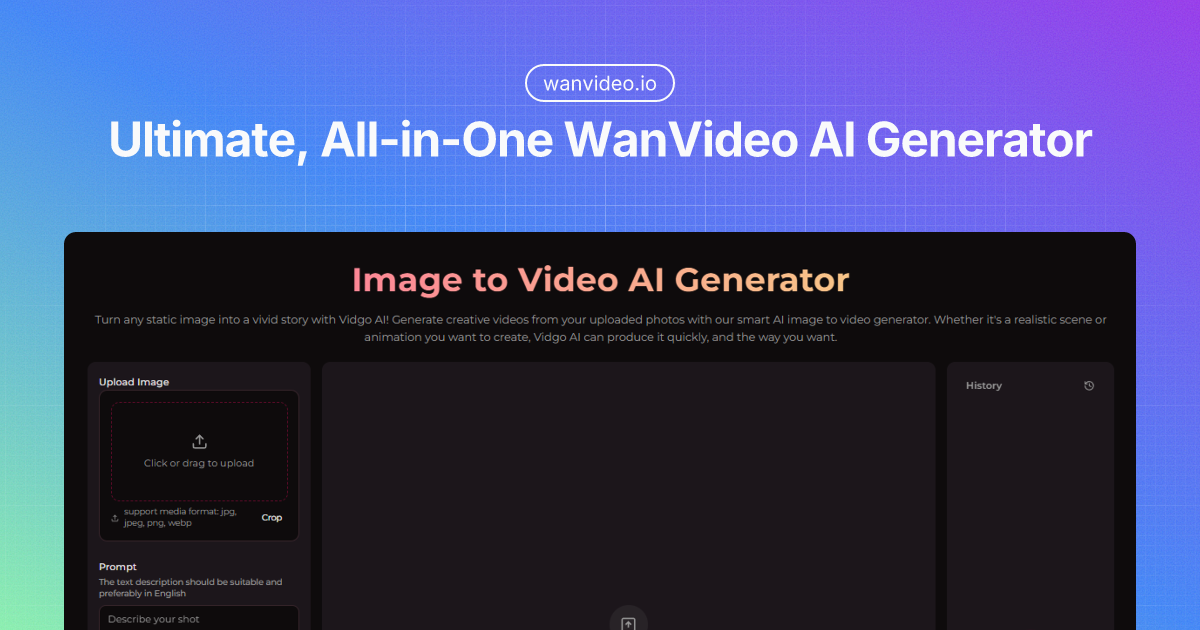

- แปลงภาพเป็นวิดีโอ

- ทิปขั้นสูงเพื่อผลลัพธ์ที่ดียิ่งขึ้น

- ข้อมูลทางเทคนิค

- เปรียบเทียบ Wan 2.1 กับโมเดลวิดีโอ AI อื่น ๆ

- อนาคตของการสร้างวิดีโอด้วย AI

- สรุป

Wan 2.1 คืออะไร?

Wan 2.1 คือโมเดล AI สร้างวิดีโอล้ำสมัยที่พัฒนาโดยห้องปฏิบัติการ Tongyi Lab ของ Alibaba เปิดเผยเป็นโอเพนซอร์สพร้อมชุดโมเดลรากฐานสำหรับสร้างวิดีโอ ถือเป็นก้าวกระโดดสำคัญที่ทำให้การสร้างวิดีโอคุณภาพสูงด้วย AI เป็นเรื่องง่ายสำหรับทุกคน ระบบ AI อันทรงพลังนี้สามารถแปลงข้อความธรรมดาหรือภาพนิ่งให้กลายเป็นวิดีโอเคลื่อนไหวสมจริงคุณภาพเยี่ยมได้

ในฐานะหนึ่งในเครื่องมือสร้างวิดีโอ AI แบบโอเพนซอร์สที่ล้ำที่สุดในปัจจุบัน Wan 2.1 ถูกนำไปใช้อย่างแพร่หลายในหมู่ผู้สร้างนักพัฒนา และผู้สนใจ AI สิ่งที่ทำให้โดดเด่นพิเศษคือลูกเล่นที่สามารถรันบนฮาร์ดแวร์ระดับผู้ใช้ทั่วไปแต่ให้ผลงานระดับมืออาชีพ

WanVideo Official Site ทำหน้าที่เป็นแพลตฟอร์มหลักที่ให้เข้าถึงเครื่องมืออันทรงพลังเหล่านี้ มีทั้งแบบใช้ฟรีและแบบพรีเมียมเพื่อตอบโจทย์ผู้ใช้ทุกรูปแบบ ไม่ว่าคุณจะเป็นนักสร้างเนื้อหา นักพัฒนาที่ต้องการฝังการสร้างวิดีโอในแอปพลิเคชัน หรือผู้สนใจอยากทดลองศักยภาพ AI — Wan 2.1 คือจุดเริ่มต้นสู่โลกอันมหัศจรรย์ของการสร้างวิดีโอด้วย AI ที่เข้าถึงง่าย

ฟีเจอร์เด่นของ Wan 2.1

Wan 2.1 โดดเด่นในกลุ่มโมเดล AI สร้างวิดีโอด้วยคุณสมบัติอันน่าประทับใจหลายอย่าง:

หลายรูปแบบการสร้างวิดีโอ

- Text-to-Video (T2V): แปลงคำบรรยายเป็นวิดีโอเคลื่อนไหวครบถ้วน

- Image-to-Video (I2V): เปลี่ยนภาพนิ่งให้เคลื่อนไหวอย่างเป็นธรรมชาติ

- Video Editing: ปรับแต่งหรือแก้ไขวิดีโอเดิม

- Text-to-Image: สร้างภาพนิ่งขึ้นจากคำบรรยาย

- Video-to-Audio: เติมเสียงให้กับวิดีโอ

ข้อได้เปรียบทางเทคนิค

- ภาพและวิดีโอคุณภาพสูง: เคลื่อนไหวลื่นไหล สมจริงตามหลักฟิสิกส์

- ความประหยัด: โมเดลขนาด 1.3B ต้องการ VRAM แค่ 8.19GB เท่านั้น ใช้การ์ดจอผู้ใช้ทั่วไปก็เหลือเฟือ

- รองรับหลายภาษา: รองรับทั้งอินพุตภาษาอังกฤษและจีน

- สถาปัตยกรรมโอเพนซอร์ส: ใช้ได้ทั้งเพื่อการศึกษา วิจัย และเชิงพาณิชย์

ประสิทธิภาพตามเกณฑ์วัด

Wan 2.1 ทำคะแนนสูงสุดบนตาราง VBench ซึ่งเป็นเกณฑ์วัดความสามารถโมเดลสร้างวิดีโอ โดยเด่นเรื่องความสมจริงของการเคลื่อนไหว ความสัมพันธ์เชิงพื้นที่ และการมีปฏิสัมพันธ์ระหว่างวัตถุหลายชนิด ส่งให้ Wan 2.1 กลายเป็นหนึ่งในระบบสร้างวิดีโอ AI ที่ทรงพลังสุดขณะนี้ เทียบเคียงกับโมเดลปิดอย่าง Sora ของ OpenAI

WanVideo ทำงานอย่างไร

เบื้องหลังเวทมนตร์ของ WanVideo คือสถาปัตยกรรม AI ขั้นสูงหลายส่วนร่วมมือกันอย่างกลมกลืน ได้แก่:

- 3D Variational Autoencoder (Wan-VAE): บีบอัดและขยายข้อมูลวิดีโออย่างมีประสิทธิภาพ

- Video Diffusion DiT: สร้างเฟรมวิดีโอคมชัดคุณภาพสูง

- Flow Matching Framework: ให้การเปลี่ยนผ่านระหว่างเฟรมสมูทและเป็นธรรมชาติ

- T5 Encoder: ประมวลผลข้อความนำเข้าให้ตรงกับความต้องการ

- Transformer Blocks with Cross-Attention: เชื่อมโยงความหมายจากข้อความเข้ากับองค์ประกอบภาพ

ระบบอันซับซ้อนนี้จะตีความสิ่งที่คุณป้อนเข้าไป (ไม่ว่าจะเป็นข้อความหรือภาพ) แล้วสร้างวิดีโอที่สอดคล้องกับภาพรวมและเนื้อหาที่คุณต้องการออกมา โดยมีหลายขั้นตอน:

- ประมวลผลอินพุต (แปลงข้อความหรือวิเคราะห์ภาพ)

- วางแผนเนื้อหาและเรียงองค์ประกอบฉาก

- สร้างภาพแต่ละเฟรมโดยรักษาความต่อเนื่อง

- เก็บรายละเอียดและปรับปรุงคุณภาพในภายหลัง

ผลลัพธ์คือวิดีโอที่ไม่เพียงดูดีเมื่อชมทีละเฟรมแต่ยังเคลื่อนไหวอย่างต่อเนื่องและสมเหตุผลตลอดทั้งคลิป

เริ่มต้นใช้งาน WanVideo

การเริ่มต้นใช้งาน WanVideo นั้นง่ายแม้สำหรับมือใหม่ มาดูวิธีเริ่มต้นเส้นทางสร้างวิดีโอ AI ของคุณกัน:

ขั้นตอนที่ 1: เลือกวิธีสร้างวิดีโอ

WanVideo มีทางเลือกหลัก 2 วิธี:

- Text-to-Video (T2V): สร้างวิดีโอจากคำบรรยาย

- Image-to-Video (I2V): สร้างวิดีโอจากภาพนิ่ง

แต่ละแบบมีข้อดีต่างกัน Text-to-Video ให้คุณสร้างเนื้อหาอย่างอิสระ ส่วน Image-to-Video คุมรูปแบบและรายละเอียดได้มากขึ้น

ขั้นตอนที่ 2: สมัครบัญชีผู้ใช้

WanVideo อนุญาตให้ใช้ฟรีในระดับหนึ่ง แต่ถ้าสมัครสมาชิกจะได้รับสิทธิพิเศษเช่น:

- ดาวน์โหลดวิดีโอความละเอียดสูง

- วิดีโอคลิปยาวขึ้น

- ฟีเจอร์แก้ไขขั้นสูง

- บันทึกโปรเจกต์และประวัติการสร้าง

- ดาวน์โหลดวิดีโอแบบไม่มีลายน้ำ

ขั้นตอนสมัครง่ายเพียงใช้อีเมล

ขั้นตอนที่ 3: เลือกเทมเพลต

WanVideo เตรียมเทมเพลตไว้ให้เลือกมากมาย:

- เลือกชมเทมเพลตที่มี

- เลือกเทมเพลตที่ตรงกับไอเดียของคุณ

- บางเทมเพลตมีเอฟเฟกต์กับพรอมต์สำเร็จรูป

- หรือจะตั้งค่าพรอมต์เองก็ได้

ขั้นตอนที่ 4: เตรียมเนื้อหาของคุณ

สำหรับ Image-to-Video:

- อัปโหลดภาพ 1 หรือ 2 ภาพ

- 1 ภาพ: แปลงภาพเดียวเป็นวิดีโอ

- 2 ภาพ: ทำวิดีโอเปรียบเทียบภาพข้างกัน

- ปรับภาพด้วยเครื่องมือครอบในตัว

- ปรับระดับซูม

- ปรับอัตราส่วนภาพ

- พรีวิวผลงานก่อนเสร็จ

- รออัปโหลดเสร็จ

สำหรับ Text-to-Video:

- พิมพ์พรอมต์ในช่องข้อความ

- ระบุฉาก การเคลื่อนไหว และสไตล์ให้ชัดเจน

- ใช้ปุ่มก็อปปี้หรือเคลียร์เพื่อจัดการพรอมต์

ขั้นตอนที่ 5: สั่งสร้างวิดีโอ

- คลิกปุ่ม "สร้างวิดีโอ (Generate Video)"

- ดำเนินขั้นตอนยืนยันตัวตน

- รอระบบประมวลผล (ปกติไม่กี่นาที)

- ผลลัพธ์จะปรากฏในแถบแสดงวิดีโอ

ขั้นตอนที่ 6: ดาวน์โหลดและแชร์

เมื่อได้วิดีโอ สามารถ:

- พรีวิววิดีโอจากเบราว์เซอร์

- ดาวน์โหลดวิดีโอพร้อมลายน้ำ (ฟรี)

- ดาวน์โหลดวิดีโอแบบไม่มีลายน้ำ (สำหรับสมาชิกพรีเมียม)

- ดูรายละเอียดการประมวลผล

- เข้าถึงประวัติการสร้างของคุณ

ขั้นตอนที่ 7: จัดการประวัติของคุณ

WanVideo เก็บประวัติการสร้างวิดีโอทั้งหมดไว้:

- เข้าถึงหน้า History ทางขวา (เดสก์ท็อป) หรือด้านล่าง (มือถือ)

- ดูผลงานก่อนหน้า

- ดาวน์โหลดวิดีโอย้อนหลัง

- ตรวจสอบรายละเอียดความสำเร็จ

- ตรวจสอบเครดิตที่เหลือ

เคล็ดลับเพื่อผลลัพธ์ดีที่สุด

- ใช้ภาพคุณภาพสูง

- ระบุพรอมต์ให้ชัดเจน

- ทดลองเทมเพลตหลากหลาย

- ตรวจสอบยอดเครดิตก่อนสั่งสร้าง

- ใช้เครื่องมือครอบให้อัตราส่วนเหมาะสม

- ใช้ภาพสองภาพสำหรับวิดีโอเปรียบเทียบ

คู่มือสร้างวิดีโอจากข้อความ

ฟีเจอร์ Text to Video ถือเป็นหัวใจของ WanVideo ที่เปลี่ยนจินตนาการของคุณเป็นวิดีโอเพียงใช้คำพูด มาเพิ่มประสิทธิภาพของพรอมต์กัน

การสร้างพรอมต์ที่มีประสิทธิภาพ

คุณภาพของพรอมต์ส่งผลโดยตรงต่อคุณภาพวิดีโอ ควรทำตามแนวทางนี้:

- เจาะจง: "รถสปอร์ตสีแดงวิ่งด้วยความเร็วบนทางเลียบชายฝั่งยามพระอาทิตย์ตก" ดูดีกว่า "รถวิ่ง"

- ใส่รายละเอียดภาพ: ระบุสี แสง อากาศ บรรยากาศ

- บรรยายการเคลื่อนไหว: เช่น "แกว่งเบา ๆ", "พุ่งด้วยความเร็วสูง"

- ระบุองค์ประกอบฉาก: ทั้งของพื้นหลังและสภาพแวดล้อม

- ใส่สไตล์: เช่น "เหมือนจริงมาก", "สไตล์อนิเมะ", "โทนภาพยนตร์"

แม่แบบพรอมต์ที่แนะนำ

[Subject] [action] in/on [location] with [details] during [time of day], [style reference]

ตัวอย่าง: "นกอินทรีย์สง่างามร่อนเหนือภูเขาหิมะ เผยปีกเป็นประกายรับแสงทองคำยามเย็น คุณภาพแบบภาพยนตร์"

ปรับแต่งค่าพารามิเตอร์

WanVideo อนุญาตให้ปรับค่าต่าง ๆ เช่น

- ความยาววิดีโอ: ปกติ 5-10 วินาที (ถ้ายาวมากอาจเสียความต่อเนื่อง)

- ความละเอียด: มาตรฐาน 480p (720p สำหรับสมาชิกรายเดือน)

- Guidance Scale: ควบคุมให้ AI ตรงกับพรอมต์มากน้อย (ค่ายิ่งสูง ยิ่งตรงตามคำสั่ง)

- Seed: จดค่าเพื่อนำไปใช้สร้างวิดีโอชุดเดียวกันในอนาคต

ปรับแต่งซ้ำเพื่อสมบูรณ์แบบ

อย่าคาดหวังวิดีโอจะตรงใจตั้งแต่ครั้งแรก ทางที่ดีที่สุดคือทดลองหลายรอบ:

- เริ่มจากพรอมต์พื้นฐาน

- ดูวิดีโอที่ได้

- ปรับแต่งพรอมต์ใหม่ตามจุดที่ได้ผลกับจุดที่ไม่ดี

- สั่งสร้างใหม่

- ทำซ้ำจนกว่าจะพอใจ

แปลงภาพเป็นวิดีโอ

ฟีเจอร์ Image to Video ทำให้ภาพนิ่ง ภาพวาด หรือภาพที่สร้างจาก AI เคลื่อนไหวเหมือนสิ่งมีชีวิต วิธีใช้งานง่าย ๆ มีดังนี้

เลือกภาพต้นฉบับที่เหมาะสม

ไม่ใช่ทุกภาพจะเหมาะสำหรับแอนิเมชัน ภาพที่เหมาะมักจะ:

- มีวัตถุเด่นชัด ขอบเขตชัดเจน

- มีแนวโน้มการเคลื่อนไหวในตัว

- การจัดองค์ประกอบดี มีทั้งฉากหน้าและฉากหลัง

- ความละเอียดสูง

ควรหลีกเลี่ยงภาพเบลอ ภาพซ้อนเยอะ หรือองค์ประกอบยุ่งยากมาก

กำหนดค่าการเคลื่อนไหว

WanVideo ช่วยให้คุณควบคุมการเคลื่อนไหวได้เช่น

- Motion Strength: กำหนดว่าให้เคลื่อนไหวแรงแค่ไหน

- Motion Direction: ทิศทางการเคลื่อนไหว

- Focus Point: จุดโฟกัสของการเคลื่อนไหว

- Duration: ความยาวคลิป

เติมคำอธิบายข้อความประกอบ

คุณสามารถเพิ่มรายละเอียดประกอบการสร้าง

- อัปโหลดภาพ

- พิมพ์พรอมต์เกี่ยวกับการเคลื่อนไหวและเอฟเฟกต์ที่ต้องการ

- ปรับค่าแต่ละตัวเลือก

- สร้างวิดีโอ

การใช้ภาพและข้อความผสมกันมักให้ผลลัพธ์ที่ดีที่สุด

ตัวเลือกปรับแต่งหลังสร้างเสร็จ

WanVideo ยังมีเครื่องมือปรับแต่งหลังสร้างเช่น:

- ปรับความเร็วเล่นวิดีโอ

- ใส่ทรานซิชัน

- เพิ่มฟิลเตอร์เอฟเฟกต์

- แทรกข้อความประกอบ

- ใส่ซาวด์ประกอบหรือดนตรีพื้นหลัง

สิ่งเหล่านี้ช่วยยกระดับผลงานจากดีให้ยอดเยี่ยม

ทิปขั้นสูงเพื่อผลลัพธ์ที่ดียิ่งขึ้น

เมื่อเข้าใจพื้นฐานดีแล้ว ลองเทคนิคขั้นสูงเหล่านี้:

การออกแบบพรอมต์ (Prompt Engineering)

- ใช้ negative prompt ระบุสิ่งที่ไม่อยากให้เกิด

- กำหนดน้ำหนักต่าง ๆ เพื่อเน้นองค์ประกอบที่ต้องการ (beautiful::0.8, detailed::1.2)

- ลิงค์พรอมต์หลายชุดสร้างเรื่องราวซับซ้อนได้

เทคนิคเชิงเทคนิค

- หากติดตั้งใช้งานเอง เลือกใช้ half-precision (fp16) ช่วยลด VRAM

- สั่งสร้างวิดีโอหลายคลิปรวดเดียวเพื่อความเร็ว

- เลือก "ancestral sampling" เพื่อไอเดียสร้างสรรค์ (แม้อาจนอกโจทย์เล็กน้อย)

เวิร์กโฟลว์สร้างสรรค์

- สร้าง storyboard ด้วยคลิปสั้น ๆ หลายคลิปแล้วนำมาต่อกัน

- ใช้ image-to-video สำหรับฉากเปิด แล้ว text-to-video สำหรับฉากแอคชัน

- ผสาน WanVideo กับเครื่องมือ AI อื่น ๆ เพื่อสร้างสรรค์ผลงานครบกระบวนการ

ปัญหาที่พบบ่อยและแนวทางแก้ไข

| ปัญหา | แนวทางแก้ |

|---|---|

| วิดีโอเคลื่อนไหวไม่ต่อเนื่อง | ระบุทิศทางการเคลื่อนไหวในพรอมต์ให้ชัดเจน |

| วัตถุหลักไม่ชัด | เขียนคำบรรยายองค์ประกอบสำคัญให้ละเอียด |

| จังหวะเวลาไม่สม่ำเสมอ | ลดความยาววิดีโอ หรือทำซีนให้เรียบง่ายขึ้น |

| ภาพเพี้ยนหรือมีจุดผิดพลาด | เปลี่ยน seed หรือให้รายละเอียดน้อยลง |

| ความละเอียดต่ำ | อัปเกรดบัญชีหรือใช้เครื่องมืออัปเกรดภาพ |

ข้อมูลทางเทคนิค

สำหรับสายเทคนิค นี่คือรายละเอียดที่อยู่เบื้องหลัง Wan 2.1:

สถาปัตยกรรมโมเดล

Wan 2.1 มี 2 ขนาดหลัก ๆ

- โมเดล 1.3 พันล้านพารามิเตอร์: น้ำหนักเบาพิเศษ ใช้ได้บนคอมบ้าน ๆ

- โมเดล 14 พันล้านพารามิเตอร์: สำหรับมืออาชีพ

รายละเอียดโครงสร้าง:

- Dimension: 1536

- Input Dimension: 16

- Output Dimension: 16

- Feedforward Dimension: 8960

- Frequency Dimension: 256

- Number of Heads: 12

- Number of Layers: 30

อ่านรายละเอียดเพิ่มได้ที่ model card บน Hugging Face และ Replicate documentation

ข้อกำหนดฮาร์ดแวร์

สำหรับโมเดล 1.3B:

- ต้องใช้ VRAM อย่างน้อย 8.19GB

- รองรับ RTX 3090/4090 ขึ้นไป

- ใช้เวลาประมวลผลราว 4 นาทีต่อวิดีโอ 5 วินาที (แบบไม่มีออปติไมซ์)

สำหรับโมเดล 14B:

- แนะนำ VRAM 24GB ขึ้นไป

- การ์ดจอมาตรฐานมืออาชีพ

- เวลาในการสร้างแล้วแต่สเปคเครื่อง

ดูรายละเอียดอัปเดตเพิ่มเติมที่ ComfyUI Wiki และ กระทู้บน Reddit

ซอฟต์แวร์ที่ต้องใช้

ถ้าจะติดตั้งใช้งานเอง:

- Python 3.8 ขึ้นไป

- PyTorch 2.0 ขึ้นไป

- CUDA 11.7+ (สำหรับใช้งาน GPU)

- FFmpeg (สำหรับประมวลผลวิดีโอ)

คู่มือการติดตั้งและแก้ไขปัญหา อ่านได้ที่ GitHub repository และ เอกสาร Alibaba Cloud

เปรียบเทียบ Wan 2.1 กับโมเดลวิดีโอ AI อื่น ๆ

Wan 2.1 ดีกว่าหรือด้อยกว่าคู่แข่งอย่างไร?

Wan 2.1 กับโมเดลปิด

| ฟีเจอร์ | Wan 2.1 | Sora ของ OpenAI | Runway Gen-2 |

|---|---|---|---|

| ความเข้าถึง | โอเพนซอร์ส | จำกัด | จ่ายค่าสมาชิก |

| ราคา | ฟรี/ถูกมาก | ยังไม่เปิดราคา | $15-$95/เดือน |

| ความยาววิดีโอ | 5-10 วินาที | สูงสุด 60 วินาที | สูงสุด 16 วินาที |

| ความละเอียด | สูงสุด 720p | สูงสุด 1080p | สูงสุด 1080p |

| ฮาร์ดแวร์ | การ์ดจอบ้าน ๆ | เซิร์ฟเวอร์ | คลาวด์เท่านั้น |

| ปรับแต่ง | สูง | จำกัด | ปานกลาง |

เปรียบเทียบประสิทธิภาพ

จุดเด่นของ Wan 2.1:

- ความสมจริงของการเคลื่อนไหวและฟิสิกส์

- รันบนคอมฯบ้าน ๆ ได้

- ยืดหยุ่น ปรับแต่งได้ตามปรารถนา

ข้อได้เปรียบของคู่แข่งบางราย:

- สร้างวิดีโอยาว (Sora)

- ความละเอียดสูงกว่าบางกรณี (รุ่นเชิงพาณิชย์)

- เก่งเรื่องใบหน้าคนหรือฉากซับซ้อน (โมเดลเฉพาะทาง)

ข้อได้เปรียบโอเพนซอร์ส คือ ชุมชนสามารถร่วมพัฒนาและปรับปรุงอย่างต่อเนื่อง

อนาคตของการสร้างวิดีโอด้วย AI

Wan 2.1 คือจุดเปลี่ยนสำคัญที่ทำให้การสร้างวิดีโอด้วย AI กลายเป็นเรื่อง“ของทุกคน” — แต่อนาคตยังมีอีกมากรอเราอยู่

แนวโน้มต่อไป

- คลิปยาวขึ้น: อนาคตจะขยายจาก 5-10 วินาทีเป็นนาที

- ความละเอียดสูงขึ้น: เตรียมพบ 1080p หรือ 4K

- ความต่อเนื่องของเวลาเป๊ะขึ้น: ฉากเคลื่อนไหวซับซ้อนก็ทำได้สมจริง

- ผสมผสานหลายสื่อ: วิดีโอ เสียง อินเทอร์แอคทีฟ ในคลิปเดียว

- โมเดลเฉพาะทาง: สำหรับสินค้าหรือแนวเนื้อหาแต่ละกลุ่ม

ตัวอย่างการประยุกต์ใช้

เมื่อ AI สร้างวิดีโอก้าวหน้า หลายวงการจะพลิกโฉม:

- ครีเอเตอร์: ยูทูปเบอร์หรือคนทั่วไปสร้างวิดีโอคุณภาพมืออาชีพ

- พาณิชย์อิเล็กทรอนิกส์: แสดงสินค้าจากภาพนิ่งแบบไดนามิก

- การศึกษา: สอนเนื้อหายาก ๆ ด้วยแอนิเมชัน

- เกมมิ่ง: ทำฉาก ซีน หรือ asset ด้วย AI

- โลกเสมือน: สร้างฉาก VR ตามสั่ง

สรุป

Wan 2.1 และ แพลตฟอร์ม WanVideo คือการปฏิวัติให้เทคโนโลยี AI สร้างวิดีโอเป็นของทุกคน ตั้งแต่มือใหม่ยันมืออาชีพ Alibaba Tongyi Lab ได้เปิดโอกาสให้ความคิดสร้างสรรค์กลายเป็นจริง — โดยไม่จำกัดด้วยข้อจำกัดทางงบประมาณหรือทักษะเทคโนโลยี

ไม่ว่าคุณจะอยากสร้าง วิดีโอจากข้อความ เปลี่ยนภาพนิ่งเป็น วิดีโอแอนิเมชัน หรือไปไกลกว่าใครด้วยพลังแห่ง AI Wan 2.1 คือจุดเริ่มต้นที่ทั้งง่าย ทั้งทรงพลัง

เช่นเดียวกับเทคโนโลยีใหม่ ๆ การใช้งานที่น่าตื่นเต้นที่สุดมักเป็นสิ่งที่เรายังจินตนาการไม่ถึง การเปิดซอร์สของ Wan 2.1 เอื้อให้เกิดนวัตกรรมอย่างรวดเร็วโดยมีนักพัฒนาและสายครีเอทจากทั่วโลกเติมเต็มศักยภาพไม่มีที่สิ้นสุด

อนาคตของวิดีโอเริ่มต้นที่นี่ — ง่ายกว่าและเข้าถึงได้กว่าที่เคย ลองเยี่ยมชม WanVideo Official Site วันนี้ แล้วเริ่มสร้างวิดีโอ AI ของคุณเอง จินตนาการคือข้อจำกัดเดียวที่คุณมี!